“أوبن إيه آي” تغلق حسابات إيرانية لاستهدافها الانتخابات الأمريكية من خلال الذكاء الاصطناعي

أغلقت شركة الذكاء الاصطناعي “أوبن إيه آي” شبكة من الحسابات الإيرانية التي شنت حملة عبر استخدام روبوت الدردشة “تشات جي بي تي“، للتأثير على الانتخابات الرئاسية الأمريكية، من خلال توليد محتوى يؤثر على الحدث السياسي الأبرز الآن في الولايات المتحدة.

ووفقًا لـ “بلومبيرغ”، فإن الشبكة الإيرانية استهدفت التأثير على الانتخابات عبر إنشاء مقالات طويلة وتعليقات على منصات التواصل الاجتماعي.

واستنادًا للوكالة الأمريكية، فأغلب المنشورات التي دشنتها الشبكة الإيرانية لم تحصل إلا على عدد قليل من الإعجابات أو المشاركات أو التعليقات، أو لم تحصل على أي منها بالمرة.

يأتي هذا فيما لم تُحدد شركة الذكاء الاصطناعي العدد الدقيق للحسابات التي تم إزالتها، فيما أشارت إلى أنها حددت عشرات الحسابات على “إنستغرام” و”إكس”.

وجاء التقرير في أعقاب الكشف عن قيام قراصنة إيرانيون باختراق حملة ترامب السياسية، ما دفع لإجراء تحقيق فيدرالي في تدخلٍ أجنبي محتمل قبل الانتخابات الأمريكية المقررة في نوفمبر المقبل.

تأثير التكنولوجيا على العمليات السياسية

وفي هذا الشأن تواصلت “أخبار الآن” مع الخبير في أمن المعلومات والذكاء الاصطناعي، بلال أسعد، الذي أكد أن: “تأثير التكنولوجيا والذكاء الاصطناعي على العمليات السياسية، بما في ذلك الانتخابات مثل الانتخابات الأمريكية، أصبح موضوعًا حيويًا في السنوات الأخيرة”.

وتابع: “مع تطور التكنولوجيا، أصبحت أدوات الذكاء الاصطناعي قادرة على لعب دور محوري في تشكيل الرأي العام، والتأثير على نتائج الانتخابات، والمشاركة بشكل مباشر أو غير مباشر في العمليات السياسية من خلال تأثير ملاك هذه التقنيات”.

التدخل في الانتخابات

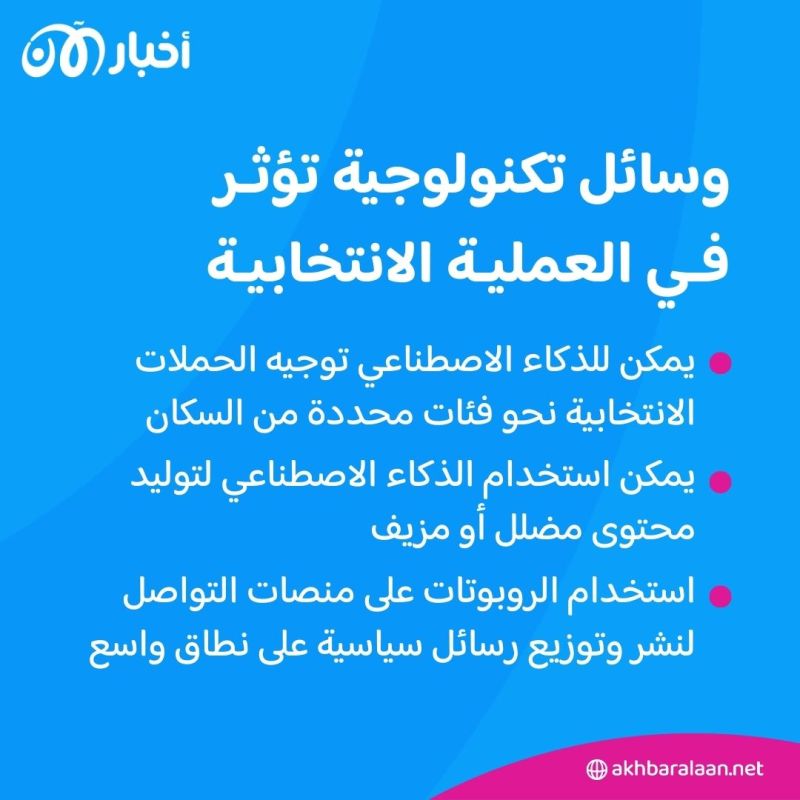

وعدّد أسعد في معرض حديثه العديد من الوسائل التي يُمكن من خلالها التأثير على العملية الانتخابية، وجاءت كالتالي:

- التحليل والاستهداف: يمكن للذكاء الاصطناعي تحليل كميات ضخمة من البيانات لتحديد الناخبين المحتملين وتوجيه الحملات الانتخابية نحو فئات محددة من السكان، ويساعد هذا التحليل في تصميم رسائل مخصصة أكثر تأثيرًا على جمهور معين، مما يزيد من فرص النجاح الانتخابي.

- التضليل ونشر الأخبار الكاذبة: يمكن استخدام الذكاء الاصطناعي لتوليد محتوى مضلل أو مزيف، مثل الأخبار الكاذبة أو المقالات الملفقة، والتي تنتشر بسرعة على وسائل التواصل الاجتماعي، وهذا التضليل يمكن أن يؤثر بشكل كبير على قرارات الناخبين ويشوه الحقيقة.

- التفاعل الآلي: يتم استخدام الروبوتات (Bots) على منصات التواصل الاجتماعي لنشر وتوزيع رسائل سياسية على نطاق واسع، مما يعطي انطباعًا مضللًا بوجود دعم شعبي كبير لموقف معين، وهذا التفاعل يمكن أن يؤثر على النقاش العام ويوجه الحوار السياسي في اتجاهات معينة.

انخراط ملاك الذكاء الاصطناعي في العمليات السياسية

وأوضح الخبير في أمن المعلومات والذكاء الاصطناعي أن انخراط شركات وملاك الذكاء الاصطناعي في السياسة يمكن أن يزيد من تأثيرهم على العمليات السياسية بطرق متعددة وهي:

- توجيه الخطاب السياسي

تحليل البيانات الضخمة: الشركات التكنولوجية الكبرى التي تمتلك تقنيات الذكاء الاصطناعي المتقدمة تستطيع جمع وتحليل كميات ضخمة من البيانات عن الناخبين، مما يمكنها من توجيه الخطاب السياسي بطرق تستهدف عواطف وتوجهات معينة، وبالتالي التأثير على توجهات الناخبين.

- التأثير على الرأي العام

من خلال التلاعب بخوارزميات التواصل الاجتماعي، يمكن للشركات التأثير في المواضيع التي تتصدر النقاشات العامة، مما يوجه الرأي العام نحو قضايا معينة تخدم مصالحهم.

- التبرعات والدعم المالي

تمويل الحملات: ملاك الشركات التكنولوجية يمكنهم تقديم دعم مالي كبير للحملات الانتخابية، مما يمنحهم نفوذًا سياسيًا قد يؤثر على السياسات المستقبلية المتعلقة بالتكنولوجيا والذكاء الاصطناعي.

التأثير في السياسات: مع النفوذ المالي الكبير، يمكن لملاك الشركات الضغط على السياسيين والأحزاب لتبني سياسات تخدم مصالحهم التجارية، بما في ذلك تنظيمات خاصة بالذكاء الاصطناعي.

استحواذ الشركات على الذكاء الاصطناعي في الحكومة

وعلى جانبٍ آخر، أشار الخبير بلال أسعد إلى أن: “الشركات التي تطور تقنيات الذكاء الاصطناعي قد تتعاقد مع الحكومات لتوفير خدمات ذكية، مما يجعل الحكومة تعتمد بشكل كبير على هذه الشركات، وبالتالي يزيد من تأثيرها على صنع القرار”.

وأكد أيضًا أن: “الحصول على مشاريع حكومية حساسة قد يمنح هذه الشركات نفوذًا إضافيًا في التأثير على السياسات العامة”.

التأثير على التشريعات والتنظيمات

ولفت أسعد كذلك إلى أنه يمكن للشركات ممارسة ضغط على المشرعين لتشكيل قوانين وسياسات تتماشى مع مصالحهم، مثل السعي للحصول على تنظيمات أقل صرامة أو الحصول على استثناءات معينة.

كما أشار – متحدثًا حول نقطة مشاركة هذه الشركات في وضع السياسات – قائلًا: “بفضل خبرتهم في التكنولوجيا، قد يلعب ملاك شركات الذكاء الاصطناعي دورًا مباشرًا في صياغة السياسات والتشريعات، إما من خلال تقديم المشورة أو الانخراط في مجموعات الضغط”.

الحد من التأثيرات

ولمواجهة هذه التحديات، توجد عدة آليات – حددها الخبير في التحول الرقمي بلال أسعد – تُتخذ للحد من تأثير التكنولوجيا والذكاء الاصطناعي في السياسة، قائلًا: “ضرورة أن تقوم بعض الدول بوضع قوانين لتنظيم استخدام الذكاء الاصطناعي في السياسة، مثل فرض الكشف عن المحتوى المدعوم بواسطة الذكاء الاصطناعي وفرض عقوبات على نشر المعلومات المضللة”.

وأضاف: “يجب تطوير تقنيات مضادة، حيث تقوم شركات التكنولوجية بابتكار تقنيات للكشف عن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي، وتحديد الحسابات الآلية التي تحاول التأثير على النقاش العام. لكن مع الأسف مثلا منصة X يتحكم بها شخص وقوانين المنصة تعتمد على توجه مالك المنصة وميوله الشخصي”.

زيادة الوعي

وفي هذا السياق، شدد أسعد على ضرورة زيادة الوعي بين الجمهور حول كيفية عمل الذكاء الاصطناعي وأثره المحتمل على التضليل، مما يُمكّن الناس من التحقق من المعلومات التي يتلقونها من مصادر متعددة. كما أشار إلى “أهمية تعزيز الجهود الدولية للتعاون في مواجهة التهديدات التي يمثلها استخدام الذكاء الاصطناعي في الانتخابات والتي تشمل تبادل المعلومات ووضع استراتيجيات مشتركة لمكافحة التضليل الرقمي”.

وفي المجمل، يجسد هذا الوضع تحديًا مركبًا يتطلب توازنًا بين الاستفادة من الابتكارات التكنولوجية وبين حماية العملية الديمقراطية من التلاعب والاستغلال غير المشروع.